IA en santé : risques, conformité AI Act et enjeux du RGPD

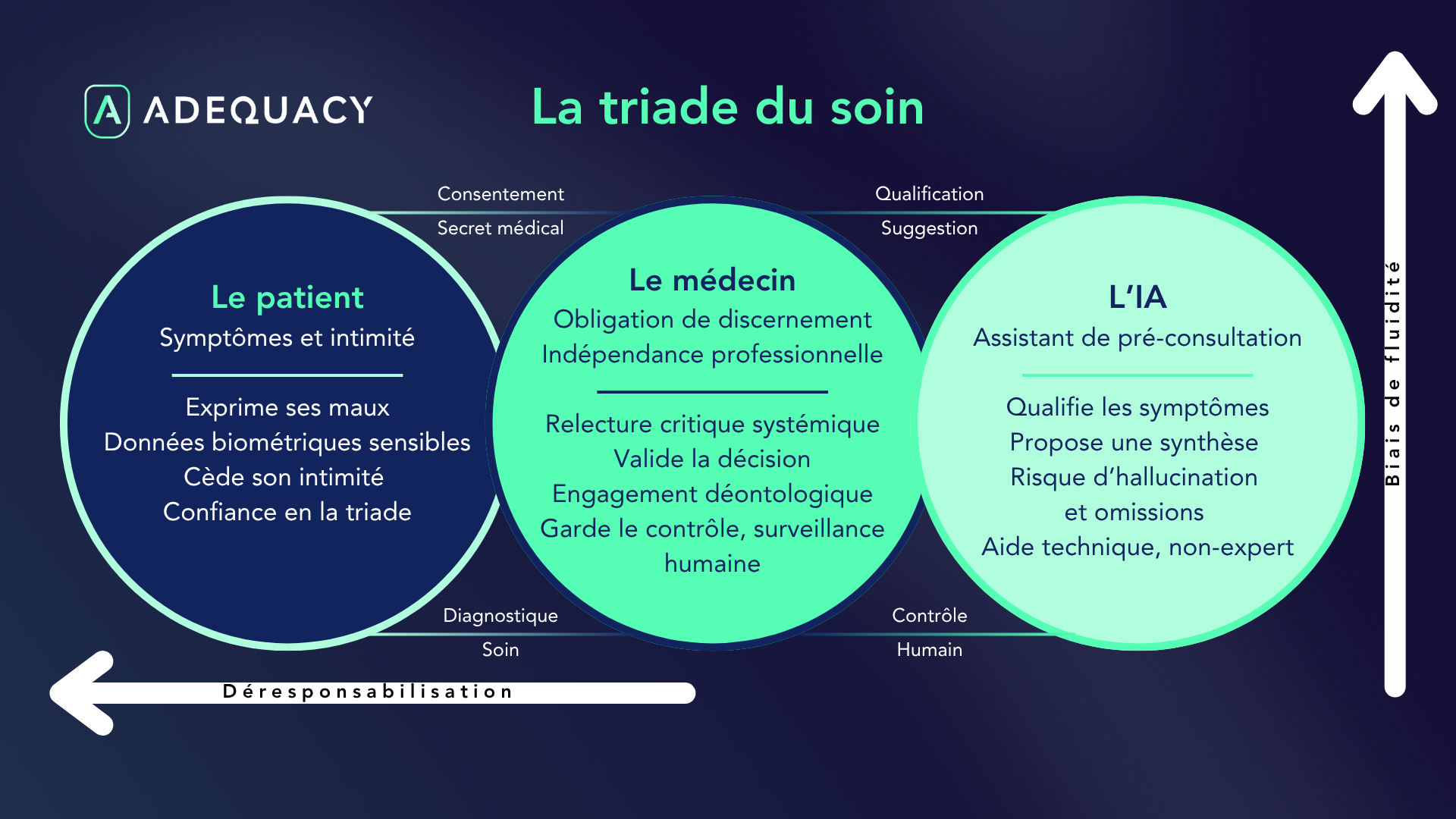

L'intégration de l'IA en santé impose de nouveaux défis de conformité liés au RGPD et à l'AI Act. Si l'ergonomie des outils facilite le soin, elle ne doit pas mener à une déresponsabilisation médicale. Pour les DPO et RSSI, l'enjeu est de garantir une surveillance humaine effective et la souveraineté des données face aux risques juridiques et techniques. Découvrez comment sécuriser vos déploiements d'IA tout en respectant le secret médical.

Le café de midi révèle parfois l’évolution des usages. Une expérience récente avec un nouveau protocole de soin en témoigne : avant même la consultation, le remplissage d'un questionnaire en ligne d'une précision chirurgicale via une plateforme dédiée est devenu la norme. Des questions si intrusives qu'elles prêtent parfois à l'ironie : « À ce stade, j'attends presque qu'on annule mon rendez-vous pour m'envoyer directement l'ordonnance par mail ! ».

Cette anecdote illustre une bascule civilisationnelle majeure. L’observation quotidienne de ces systèmes laisse poindre un risque systémique : celui de la déresponsabilisation par le confort numérique. Ce phénomène rappelle les dérives du sharenting : cette propension à céder les données les plus sensibles pour un bénéfice immédiat, sans toujours mesurer la portée de cet abandon d’intimité au profit de la machine.

L'intégration de l'IA en santé ne se limite pas à une simple innovation technique. Si elle promet une meilleure qualification des symptômes et un soutien aux territoires isolés, elle impose de nouveaux défis de conformité liés au RGPD et à l'IA Act. Entre biais de fluidité et impératifs de surveillance humaine, les DPO et professionnels de la donnée doivent naviguer entre bénéfices immédiats et protection à long terme de l'intimité médicale.

Les bénéfices de l'IA en santé : une réponse à la crise du soin

Il serait réducteur de ne voir dans ces outils qu'une menace. La multiplication de ces usages répond à une crise profonde de notre système de soin. L'IA, lorsqu'elle est intégrée avec éthique, apporte des bénéfices concrets :

- Une meilleure qualification : elle assure qu'aucun symptôme n'est omis dans le stress de la consultation et permet au patient de préparer son historique sereinement

- Le repérage des signaux faibles : les algorithmes excellent dans l'identification de corrélations complexes qui pourraient échapper à un praticien en fin de garde

- Le maintien du lien médical : dans les territoires isolés, les cabines de téléconsultation et les bornes de pré-accueil sont parfois les derniers remparts contre le renoncement aux soins

L'enjeu n'est donc pas de rejeter l'innovation, mais de comprendre à quel moment l'ergonomie commence à masquer le risque.

Le biais de fluidité : les risques de la collecte de données de santé

Nous assistons à une mutation de l'examen clinique vers une expérience utilisateur (UX) si parfaitement huilée qu'elle en devient anesthésiante. C'est ici que se situe le point de bascule : le biais de fluidité. En rendant le processus de collecte de données "sans couture", on élimine la friction cognitive nécessaire à la prise de décision.

Le patient, porté par la facilité de l'interface, transmet des informations biométriques hautement sensibles avec une légèreté qu'il n'aurait jamais eue face à un interrogatoire humain direct. La fluidité devient un écran de fumée : parce que le processus est rapide et intuitif, on finit par oublier la dimension critique de l'acte. La commodité l'emporte sur la conscience du risque.

Efficacité médicale vs rendement : l'impact de l'IA sur le temps médical

L'IA promet de libérer du temps médical en déléguant le débroussaillage administratif. Cependant, les chiffres de l'Assurance Maladie montrent que les médecins épaulés par des outils automatisés ou des assistants enregistrent une progression de leur patientèle de près de 20 %.

Le piège est structurel : si ce gain de temps est systématiquement réinvesti pour augmenter la cadence et éponger les flux, l'IA ne sert plus le soin, mais devient un moteur de rendement industriel. Le risque est de voir le soin passer d'un colloque singulier à une chaîne de montage où l'algorithme joue le rôle de contremaître. Le médecin risque alors de perdre la maîtrise du temps long, indispensable à la qualité diagnostique.

Responsabilité juridique et conformité à l'IA Act en secteur médical

Juridiquement, l'acte de validation technique — ce fameux bouton vert — opère une bascule irréversible : il transforme une simple probabilité statistique produite par une machine en une décision médicale souveraine. Ce n'est pas une simple formalité administrative, c'est le point de rencontre entre le droit de la preuve et la déontologie.

Indépendance du médecin et déontologie face aux algorithmes

Selon le Code de la santé publique (Art. R4127-40), le médecin doit exercer sa mission en toute indépendance. Suivre aveuglément un algorithme n'est pas une aide à la décision, c'est un abandon de cette indépendance. Pour le juge, l’IA reste un outil d’aide et non un expert. En validant une suggestion, le praticien endosse l’entièreté des conséquences d’une éventuelle hallucination ou erreur de l’IA.

Obligations de surveillance humaine et diligence raisonnable selon l'AI Act

Depuis août 2024, le règlement européen sur l'IA (IA Act) classe la santé comme secteur à haut risque. Cela impose au professionnel une surveillance humaine (human oversight). Ce n'est plus seulement ne pas faire d'erreur, c'est démontrer que l'on a gardé le contrôle. Le clic sur le bouton vert sans contre-expertise clinique pourrait être qualifié de faute caractérisée par le défaut de vigilance.

Responsabilité civile et perte de chance liée à l'erreur de l'IA

Si l’IA omet un diagnostic vital et que le médecin valide cette omission d'un clic trop rapide, le lien de causalité entre l'absence de vérification et la perte de chance du patient devient direct. La facilité de l'interface ne constitue jamais une circonstance atténuante devant une juridiction ; elle est le révélateur d'un manquement à l'obligation de moyens.

Souveraineté numérique : Cloud Act, label HDS et secret médical

La confiance ne peut se limiter à une conformité de façade. Le label HDS (Hébergeur de Données de Santé) est une garantie technique indispensable, mais il ne garantit pas la souveraineté.

Une donnée stockée n'est pas une donnée sanctuarisée si l'infrastructure appartient à un acteur soumis à des législations extraterritoriales comme le Cloud Act. La véritable protection exige des infrastructures sous droit strictement européen. Sans souveraineté juridique, le secret médical devient une promesse fragile, quel que soit le bénéfice immédiat apporté par l'outil.

Conclusion : réintroduire la vigilance dans l'usage de l'IA en santé

L'évolution vers une santé augmentée est une opportunité, mais elle impose de sortir de l'hypnose de la fluidité. Nous devons réintroduire de la friction là où elle est nécessaire : dans le consentement, dans la réflexion et dans l'expertise humaine.

La technologie est un levier magnifique tant qu'elle reste un instrument de précision ; elle devient un filtre déshumanisant dès lors qu'elle dicte la relation soignant-soigné. Ne traitons pas nos données de santé avec la même légèreté que l'on traite l'image de nos enfants en ligne. La protection de notre intimité médicale est le grand défi de notre siècle numérique : l'efficience ne doit jamais se payer au prix de notre discernement.

FAQ - l'IA en santé et la conformité AI Act

Quels sont les risques de l'IA en santé pour la protection des données ?

Le principal risque réside dans le biais de fluidité, où l'ergonomie des interfaces pousse les patients à partager des données biométriques sensibles sans pleine conscience des enjeux. La conformité RGPD impose pourtant une information claire et un consentement éclairé.

Comment l'IA Act encadre-t-il l'utilisation de l'IA dans le secteur médical ?

Depuis août 2024, l'IA Act classe la santé comme un secteur à haut risque. Cela impose une surveillance humaine (human oversight) constante. Le professionnel doit démontrer qu'il garde le contrôle sur l'outil et ne valide pas aveuglément les suggestions de l'algorithme.

Le label HDS suffit-il à garantir la souveraineté des données de santé ?

Non, le label HDS assure une sécurité technique mais pas la souveraineté juridique. Si l'hébergeur est soumis à des lois extraterritoriales comme le Cloud Act, le secret médical peut être compromis. Une protection réelle exige des infrastructures sous droit strictement européen.